Rețelele neuronale sunt modele de calcul care imită funcțiile complexe ale creierului uman. Rețelele neuronale constau din noduri sau neuroni interconectați care procesează și învață din date, permițând sarcini precum recunoașterea modelelor și luarea deciziilor în învățarea automată. Articolul explorează mai multe despre rețelele neuronale, funcționarea acestora, arhitectura și multe altele.

Cuprins

- Evoluția rețelelor neuronale

- Ce sunt rețelele neuronale?

- Cum funcționează rețelele neuronale?

- Învățarea unei rețele neuronale

- Tipuri de rețele neuronale

- Implementarea simplă a unei rețele neuronale

Evoluția rețelelor neuronale

Începând cu anii 1940, au existat o serie de progrese remarcabile în domeniul rețelelor neuronale:

- Anii 1940-1950: concepte timpurii

Rețelele neuronale au început odată cu introducerea primului model matematic de neuroni artificiali de către McCulloch și Pitts. Dar constrângerile de calcul au făcut progresul dificil.

- Anii 1960-1970: Perceptroni

Această eră este definită de lucrările lui Rosenblatt asupra perceptronilor. Perceptronii sunt rețele cu un singur strat a căror aplicabilitate era limitată la probleme care puteau fi rezolvate liniar separat.

- 1980: Backpropagation and Connectionism

Rețea cu mai multe straturi antrenamentul a fost posibil prin inventarea metodei de propagare inversă de către Rumelhart, Hinton și Williams. Având accent pe învățarea prin noduri interconectate, conexiunea a câștigat atractivitate.

- Anii 1990: Boom și iarnă

Cu aplicații în identificarea imaginilor, finanțe și alte domenii, rețelele neuronale au cunoscut un boom. Cercetarea rețelelor neuronale a experimentat totuși o iarnă din cauza costurilor de calcul exorbitante și a așteptărilor umflate.

- Anii 2000: renaștere și învățare profundă

Seturile de date mai mari, structurile inovatoare și capacitatea de procesare îmbunătățită au stimulat o revenire. Invatare profunda a demonstrat o eficacitate uimitoare într-o serie de discipline prin utilizarea a numeroase straturi.

- Anii 2010-Prezen: Deep Learning Dominance

Rețelele neuronale convoluționale (CNN) și rețelele neuronale recurente (RNN), două arhitecturi de învățare profundă, au dominat învățarea automată. Puterea lor a fost demonstrată de inovații în jocuri, recunoașterea imaginilor și procesarea limbajului natural.

Ce sunt rețelele neuronale?

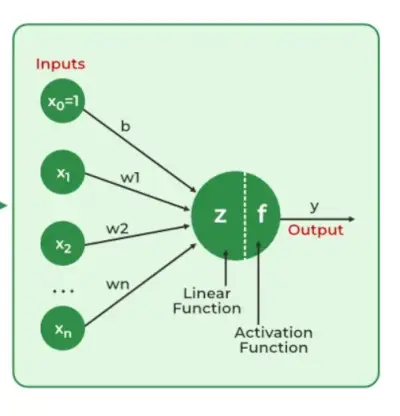

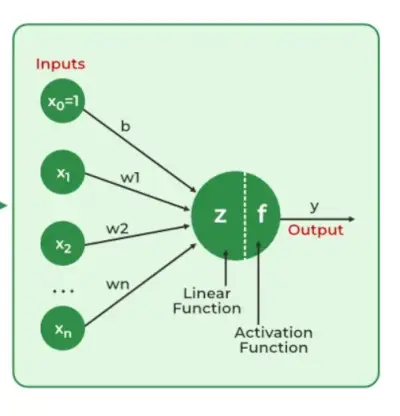

Rețele neuronale extrageți caracteristici de identificare din date, fără înțelegere pre-programată. Componentele rețelei includ neuroni, conexiuni, ponderi, părtiniri, funcții de propagare și o regulă de învățare. Neuronii primesc intrări, guvernate de praguri și funcții de activare. Conexiunile implică ponderi și părtiniri care reglementează transferul de informații. Învățarea, ajustarea ponderilor și a prejudecăților, are loc în trei etape: calculul intrărilor, generarea de ieșiri și rafinarea iterativă care sporește competența rețelei în diverse sarcini.

Acestea includ:

- Rețeaua neuronală este simulată de un mediu nou.

- Apoi parametrii liberi ai rețelei neuronale sunt modificați ca rezultat al acestei simulări.

- Rețeaua neuronală răspunde apoi într-un mod nou la mediu din cauza modificărilor parametrilor săi liberi.

Importanța rețelelor neuronale

Capacitatea rețelelor neuronale de a identifica tipare, de a rezolva puzzle-uri complicate și de a se adapta la mediul în schimbare este esențială. Capacitatea lor de a învăța din date are efecte de anvergură, variind de la revoluționarea tehnologiei, cum ar fi procesarea limbajului natural și automobile cu conducere autonomă la automatizarea proceselor de luare a deciziilor și creșterea eficienței în numeroase industrii. Dezvoltarea inteligenței artificiale depinde în mare măsură de rețelele neuronale, care, de asemenea, stimulează inovația și influențează direcția tehnologiei.

Cum funcționează rețelele neuronale?

Să înțelegem cu un exemplu cum funcționează o rețea neuronală:

Luați în considerare o rețea neuronală pentru clasificarea e-mailurilor. Stratul de intrare preia caracteristici precum conținutul e-mailului, informațiile despre expeditor și subiectul. Aceste intrări, înmulțite cu greutățile ajustate, trec prin straturi ascunse. Rețeaua, prin instruire, învață să recunoască tiparele care indică dacă un e-mail este sau nu spam. Stratul de ieșire, cu o funcție de activare binară, prezice dacă e-mailul este spam (1) sau nu (0). Pe măsură ce rețeaua își rafinește în mod iterativ ponderile prin backpropagare, devine abil să facă distincția între spam și e-mailuri legitime, arătând caracterul practic al rețelelor neuronale în aplicațiile din lumea reală, cum ar fi filtrarea e-mailurilor.

Funcționarea unei rețele neuronale

Rețelele neuronale sunt sisteme complexe care imită unele caracteristici ale funcționării creierului uman. Este compus dintr-un strat de intrare, unul sau mai multe straturi ascunse și un strat de ieșire format din straturi de neuroni artificiali care sunt cuplati. Cele două etape ale procesului de bază se numesc retropropagare și propagare înainte .

Propagare înainte

- Strat de intrare: Fiecare caracteristică din stratul de intrare este reprezentată de un nod din rețea, care primește datele de intrare.

- Greutăți și conexiuni: Greutatea fiecărei conexiuni neuronale indică cât de puternică este conexiunea. Pe parcursul antrenamentului, aceste greutăți sunt modificate.

- Straturi ascunse: Fiecare neuron de strat ascuns procesează intrările înmulțindu-le cu greutăți, adunându-le și apoi trecându-le printr-o funcție de activare. Făcând acest lucru, este introdusă neliniaritatea, permițând rețelei să recunoască modele complicate.

- Ieșire: Rezultatul final este produs prin repetarea procesului până când se ajunge la nivelul de ieșire.

Propagarea inversă

- Calculul pierderilor: Ieșirea rețelei este evaluată în raport cu valorile reale ale obiectivului și este utilizată o funcție de pierdere pentru a calcula diferența. Pentru o problemă de regresie, Eroare medie pătratică (MSE) este utilizat în mod obișnuit ca funcție de cost.

Funcția de pierdere:

- Coborâre în gradient: Coborârea în gradient este apoi utilizată de rețea pentru a reduce pierderea. Pentru a reduce inexactitatea, greutățile sunt modificate în funcție de derivata pierderii în raport cu fiecare greutate.

- Ajustarea greutăților: Greutățile sunt ajustate la fiecare conexiune prin aplicarea acestui proces iterativ sau retropropagare , înapoi în rețea.

- Instruire: În timpul antrenamentului cu diferite eșantioane de date, întregul proces de propagare înainte, calcul al pierderilor și propagare inversă se face iterativ, permițând rețelei să se adapteze și să învețe modele din date.

- Funcții de activare: Neliniaritatea modelului este introdusă de funcții de activare precum unitate liniară rectificată (ReLU) or sigmoid . Decizia lor cu privire la declanșarea unui neuron se bazează pe întreaga intrare ponderată.

Învățarea unei rețele neuronale

1. Învățare cu învățare supravegheată

În învăţare supravegheată , rețeaua neuronală este ghidată de un profesor care are acces la ambele perechi intrare-ieșire. Rețeaua creează ieșiri pe baza intrărilor fără a ține cont de împrejurimi. Prin compararea acestor ieșiri cu ieșirile dorite cunoscute de profesor, este generat un semnal de eroare. Pentru a reduce erorile, parametrii rețelei sunt modificați iterativ și se opresc atunci când performanța este la un nivel acceptabil.

2. Învățare cu învățare nesupravegheată

Variabilele de ieșire echivalente sunt absente în învăţare nesupravegheată . Scopul său principal este de a înțelege structura de bază a datelor primite (X). Niciun instructor nu este prezent pentru a oferi sfaturi. Modelarea modelelor de date și a relațiilor este rezultatul dorit. Cuvinte precum regresie și clasificare sunt legate de învățarea supravegheată, în timp ce învățarea nesupravegheată este asociată cu gruparea și asociere.

3. Învățare cu Învățare prin întărire

Prin interacțiunea cu mediul și feedback-ul sub formă de recompense sau penalități, rețeaua dobândește cunoștințe. Găsirea unei politici sau strategie care optimizează recompensele cumulate în timp este scopul rețelei. Acest tip este frecvent utilizat în aplicații de jocuri și de luare a deciziilor.

Tipuri de rețele neuronale

Sunt Șapte tipuri de rețele neuronale care pot fi utilizate.

- Rețele Feedforward: A rețea neuronală feedforward este o arhitectură simplă de rețea neuronală artificială în care datele se deplasează de la intrare la ieșire într-o singură direcție. Are straturi de intrare, ascunse și de ieșire; buclele de feedback sunt absente. Arhitectura sa simplă îl face potrivit pentru o serie de aplicații, cum ar fi regresia și recunoașterea modelelor.

- Perceptron multistrat (MLP): MLP este un tip de rețea neuronală feedforward cu trei sau mai multe straturi, inclusiv un strat de intrare, unul sau mai multe straturi ascunse și un strat de ieșire. Utilizează funcții de activare neliniare.

- Rețeaua neuronală convoluțională (CNN): A Rețeaua neuronală convoluțională (CNN) este o rețea neuronală artificială specializată concepută pentru procesarea imaginilor. Utilizează straturi convoluționale pentru a învăța automat caracteristicile ierarhice din imaginile de intrare, permițând recunoașterea și clasificarea eficientă a imaginilor. CNN-urile au revoluționat viziunea computerizată și sunt esențiale în sarcini precum detectarea obiectelor și analiza imaginilor.

- Rețeaua neuronală recurentă (RNN): Un tip de rețea neuronală artificială destinat procesării secvențiale a datelor se numește a Rețeaua neuronală recurentă (RNN). Este potrivit pentru aplicațiile în care dependențele contextuale sunt critice, cum ar fi predicția în serie de timp și procesarea limbajului natural, deoarece utilizează bucle de feedback, care permit informațiilor să supraviețuiască în rețea.

- Memoria pe termen lung pe termen scurt (LSTM): LSTM este un tip de RNN care este conceput pentru a depăși problema gradientului de dispariție în formarea RNN-urilor. Utilizează celule de memorie și porți pentru a citi, scrie și șterge informații în mod selectiv.

Implementarea simplă a unei rețele neuronale

Python3

import> numpy as np> # array of any amount of numbers. n = m> X>=> np.array([[>1>,>2>,>3>],> >[>3>,>4>,>1>],> >[>2>,>5>,>3>]])> # multiplication> y>=> np.array([[.>5>, .>3>, .>2>]])> # transpose of y> y>=> y.T> # sigma value> sigm>=> 2> # find the delta> delt>=> np.random.random((>3>,>3>))>-> 1> for> j>in> range>(>100>):> > ># find matrix 1. 100 layers.> >m1>=> (y>-> (>1>/>(>1> +> np.exp(>->(np.dot((>1>/>(>1> +> np.exp(> >->(np.dot(X, sigm))))), delt))))))>*>((>1>/>(> >1> +> np.exp(>->(np.dot((>1>/>(>1> +> np.exp(> >->(np.dot(X, sigm))))), delt)))))>*>(>1>->(>1>/>(> >1> +> np.exp(>->(np.dot((>1>/>(>1> +> np.exp(> >->(np.dot(X, sigm))))), delt)))))))> ># find matrix 2> >m2>=> m1.dot(delt.T)>*> ((>1>/>(>1> +> np.exp(>->(np.dot(X, sigm)))))> >*> (>1>->(>1>/>(>1> +> np.exp(>->(np.dot(X, sigm)))))))> ># find delta> >delt>=> delt>+> (>1>/>(>1> +> np.exp(>->(np.dot(X, sigm))))).T.dot(m1)> ># find sigma> >sigm>=> sigm>+> (X.T.dot(m2))> # print output from the matrix> print>(>1>/>(>1> +> np.exp(>->(np.dot(X, sigm)))))> |

>

>

Ieșire:

[[0.99999325 0.99999375 0.99999352] [0.99999988 0.99999989 0.99999988] [1. 1. 1. ]]>

Avantajele rețelelor neuronale

Rețelele neuronale sunt utilizate pe scară largă în multe aplicații diferite datorită numeroaselor beneficii:

- Adaptabilitate: Rețelele neuronale sunt utile pentru activitățile în care legătura dintre intrări și ieșiri este complexă sau nu este bine definită, deoarece se pot adapta la situații noi și pot învăța din date.

- Recunoasterea formelor: Competența lor în recunoașterea modelelor îi face eficienți în sarcini precum identificarea audio și a imaginilor, procesarea limbajului natural și alte modele complexe de date.

- Procesare paralelă: Deoarece rețelele neuronale sunt capabile de procesare paralelă prin natura lor, ele pot procesa numeroase lucrări simultan, ceea ce accelerează și îmbunătățește eficiența calculelor.

- Non-liniaritate: Rețelele neuronale sunt capabile să modeleze și să înțeleagă relații complicate în date în virtutea funcțiilor de activare neliniară găsite în neuroni, care depășesc dezavantajele modelelor liniare.

Dezavantajele rețelelor neuronale

Rețelele neuronale, deși puternice, nu sunt lipsite de dezavantaje și dificultăți:

- Intensitate de calcul: Antrenamentul rețelelor neuronale mari poate fi un proces laborios și solicitant din punct de vedere computațional, care necesită multă putere de calcul.

- Cutia neagră Natura: Ca modele cutie neagră, rețelele neuronale reprezintă o problemă în aplicații importante, deoarece este dificil de înțeles cum iau decizii.

- Supramontare: Supraadaptarea este un fenomen în care rețelele neuronale comit material de instruire în memorie, mai degrabă decât identificarea tiparelor în date. Deși abordările de regularizare ajută la atenuarea acestui lucru, problema încă există.

- Nevoia de seturi mari de date: Pentru un antrenament eficient, rețelele neuronale au nevoie frecvent de seturi de date mari, etichetate; în caz contrar, performanța lor poate avea de suferit din cauza datelor incomplete sau denaturate.

Întrebări frecvente (FAQs)

1. Ce este o rețea neuronală?

O rețea neuronală este un sistem artificial format din noduri interconectate (neuroni) care procesează informații, modelate după structura creierului uman. Este folosit în joburile de învățare automată în care modelele sunt extrase din date.

2. Cum funcționează o rețea neuronală?

Straturi de neuroni conectați procesează datele în rețelele neuronale. Rețeaua procesează datele de intrare, modifică greutățile în timpul antrenamentului și produce o ieșire în funcție de tiparele pe care le-a descoperit.

3. Care sunt tipurile comune de arhitecturi de rețele neuronale?

Rețelele neuronale feedforward, rețelele neuronale recurente (RNN), rețelele neuronale convoluționale (CNN) și rețelele de memorie pe termen lung (LSTM) sunt exemple de arhitecturi comune care sunt fiecare proiectate pentru o anumită sarcină.

4. Care este diferența dintre învățarea supravegheată și nesupravegheată în rețelele neuronale?

În învățarea supravegheată, datele etichetate sunt folosite pentru a antrena o rețea neuronală, astfel încât să învețe să mapați intrările la ieșirile care se potrivesc. Învățarea nesupravegheată funcționează cu date neetichetate și caută structuri sau modele în date .

5. Cum gestionează rețelele neuronale datele secvențiale?

Buclele de feedback pe care le încorporează rețelele neuronale recurente (RNN) le permit să proceseze date secvențiale și, în timp, să capteze dependențele și contextul.